这是2018 ECCV的一篇论文,主要讲的是双目风格迁移。这里主要说一下个人的理解。

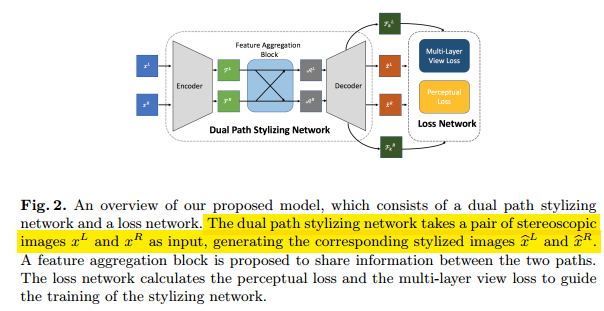

如果有双目图像,分别进行风格迁移会导致严重的不一致性,因为风格迁移本省是一个不稳定的过程。所以这篇文章主要使用以下点去做双目的风格迁移:1.双路径网络对左右图像分别进行处理。2.使用特征增强模块去合理的融合特征。3.使用多层loss去保持输出图像的风格一致性。论文的方法主要包括一个风格转换网络和一个loss网络,如下所示:

Dual Path Stylizing Network

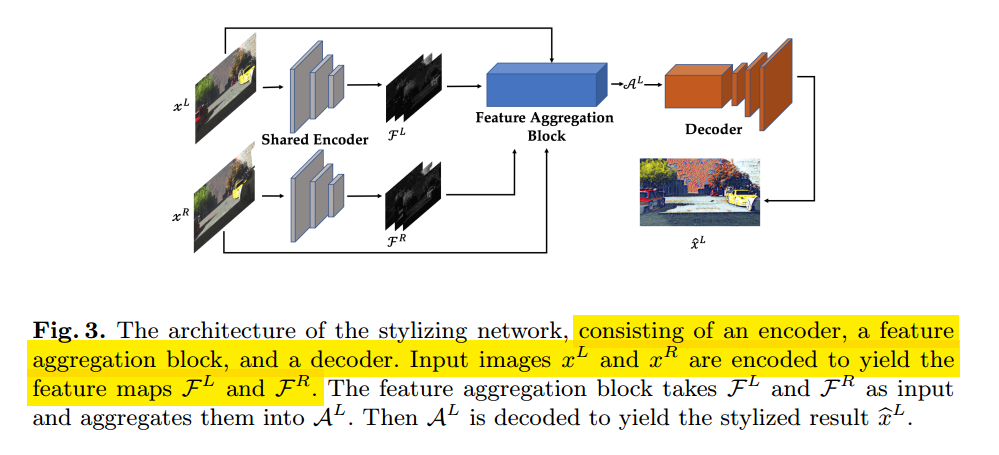

首先说一下风格转换网络,包括一个encoder,一个特征增强模块和一个decoder。如下所示,这里encoder和decoder网络对于两路图像是权重共享的。

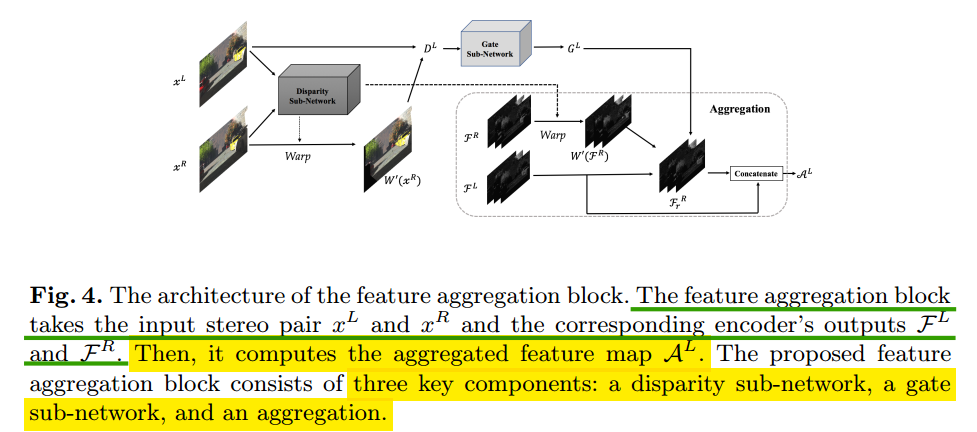

对于特征增强模块,如下所示,用左路做示例。这里先通过一个深度估计网络得到一个disparity,然后将深度图和$F^R$进行warp,使得和$F^L$对齐,为$W’(F^R)$。当然这里没有将$F^L$和$W’(F^R)$直接concat,而是先通过一个引导网络refine$W’(F^R)$,产生refine的右特征$F_r^R$。这里深度估计网络输入的是左右图的concat,是一个预训练好的网络。

这里引导的门网络,输入是左右两张图,然后使用深度图warp,计算warp之后的图像和左图像的绝对差,为$D^L=|r(X^L)-W’(r(x^R)|$,将其输入gate sub网络,得到单通道的$G^L$用来refine上面warp后的右特征。这一步个人感觉是为了消除左右两边的不一致性。最后refine的右特征为$F_r^R=W’(F^R) \odot G^L+F^L\odot(1-G^L)$。其和$F^L$warp后为左边的输出特征$A^L$,送入decoder。

Loss Network

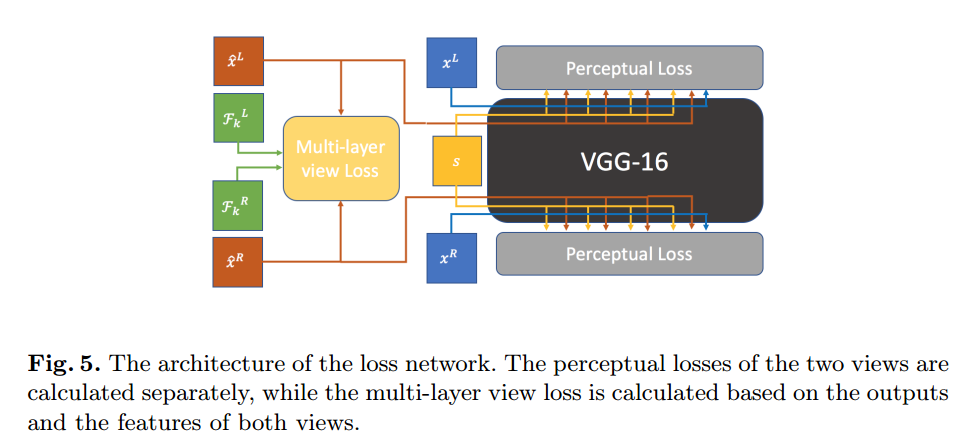

这里的loss是两部分,一部分是学习style,还有一部分是使得左右两部分具有一致性。如下图所示:

其中perceptual loss包括一个基于VGG网络的loss和一个基于Gram矩阵的loss,不赘述。

Multi-layer View Loss包括输出图像之间的一致性,以及特征一致性的网络,从输出图像和特征两个层面进行约束,这里不赘述,详情看论文。