这是2017 CVPR一篇做图像恢复的一篇论文,其实没怎么看懂。论文使用CNN去模拟AM算法。图像恢复任务通常可以看做是一个能量最小化加上一个明确的正则损失项。AM是迭代最小化,这里能量函数被分解为一系列的简单问题去优化。这篇论文的特别之处在于其不仅仅学习卷积恢复的结果,还学习AM算法的正则项,并且使用AM算法里汇总的方式,从而达到好的恢复效果。

图像恢复任务通常表示为如下形式:

其中u是输出的图像,f是观察到的图像,例如是双线性上采样的结果,Du表示的是图像在x和y方向上的导数,$\Phi$是正则函数。这里使用AM算法去解决这个问题,令v = Du,则使用AM算法解决上式可以表示成下式:

其中$\beta$是惩罚参数,AM算法由如下重复的步骤组成:

从上面可以看出选择好$\beta$和$\Phi$是非常重要的,这里可以通过网络去进行学习。上述式子通过网络学习流程如下:

这里学习参数$\gamma$是平衡系数,也是学习得到的,上式可以通过下式来解:

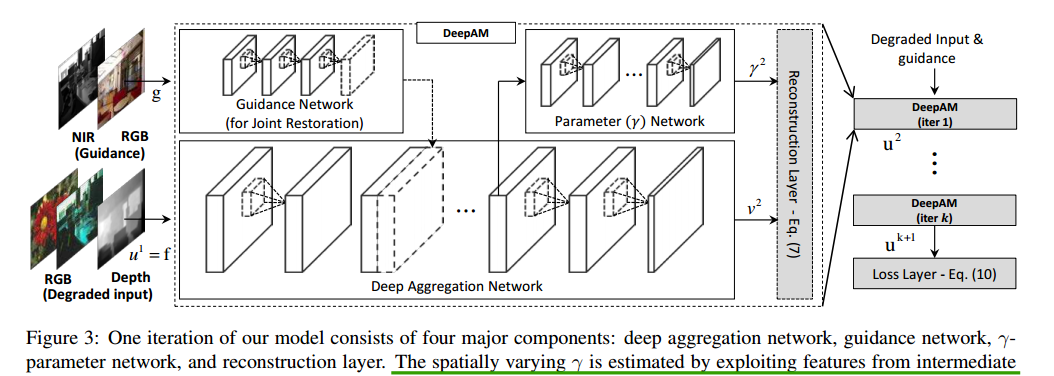

上式可以保持图像的空间一致性,这里使用PCG算法对上式进行求解,网络结构图如下所示:

如上图所示,这里DeepAM是迭代了K次。当$\beta$值很小时,v也是减小的,从而对较大的梯度区域进行惩罚,所以$\beta$较大可以增加高频区域。这里v不需要一定是正值,所以不使用relu,而$\gamma$是正值,所以需要使用relu激活函数。最终论文使用的loss是L1 loss,其他部分见论文。