2018 cvpr的一篇论文,做的是字体风格迁移。这里分为了两步,第一步是对整体的字体形状进行建模,第二步是迁移颜色和纹理。分别用GlyphNet和 OrnaNet 两个部分操作。整体结构如下所示:

首先对于GlyphNet,其输入如下所示:

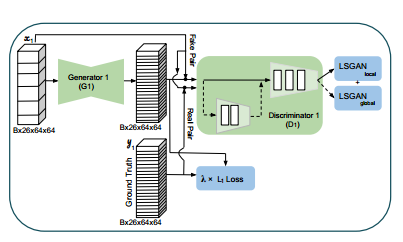

该部分基于的基础是cGAN,这里将模仿的字母作为输入,维度为Bx26x64x64,B是batch大小,26是26个字母。这里全部输入26个字母很难获得它们之间的关联性,所以这里将它们堆在一起,在channel维度上去发掘它们之间的关联性,网络的输出也是Bx26x64x64。判别器使用局部判别和全局判别相结合。最后的loss表示为:

其中第一项是生成和真实的L1 loss,第二项是全局和局部的LSGAN loss。这里训练好的GlyphNet称为G1’,在第二步里会去掉判别器。

第二步只考虑OrnaNet,采用leave one out 通过GlyphNet生成字形,具体而言是观察到Tower五个字母,依次排除其中一个将另外四个输入,预测被抽出的那个字母。最后在五个字母全部都在的情况下预测其余21个字母。将预测的21个字母和前面预测的字母合在一起变为1x26x64x64作为OrnaNet的输入。也就是说,OraNet 最后的输出就是最后完整的 26 个艺术字。

将上述输入重复成三个通道作为输入,生成图像也是三通道的彩色图。该部分的loss除了包括上面G1和GT的loss,还包括判别器D2的全局和局部LSGAN loss,以及G2输出和label之间的的L1 loss,G2输入和输出的L2 loss,和G2输入和label的loss,总之有点复杂。

亮点还是使用留一法获得字形,分部训练进行迁移。