ICCV 2019的论文,别人的博客应该写了很多了。这里就随便写写,想看详细的可以去看大佬写的博客。简而言之,这篇论文的主要贡献是提供了一个成对的raw video数据集,同时提出了一个针对raw video增强的pipeline。

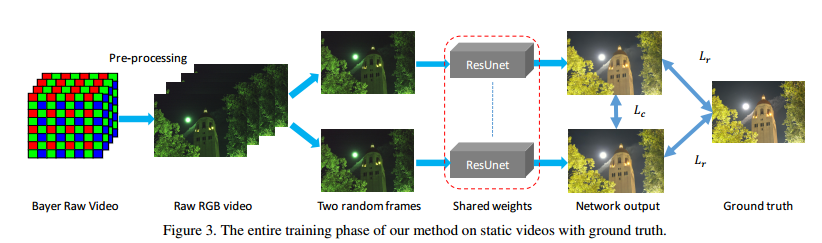

数据采集部分见论文,和其前作“Learning to see in the dark”是一样的。这里重点看一下其pipeline,如下图所示:

如上所示,这里输入的数据先通过预处理变为raw rgb的形式,包含bayer2rawRGB、black level subtraction, binning以及全局数字增益等步骤。该网络输入是单帧的输入,在训练时,其采取的是双路的结构,任取两帧分别输入,当然网络权重是共享的,输出图片和GT做VGG特征上的L1 loss实现保真,同时两路输出也做相同的loss实现时间上的一致性。