这是2019 CVPR一个做图像恢复的论文,原理感觉还是有点扯淡的。这里简要谈一下我的理解。

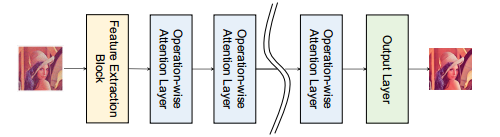

论文认为图像质量下降是由于多种因素导致的,其使用多个平行的操作,这些操作的权重通过attention机制进行学习,从而选择合适的操作,这篇论文和其他论文用attention的不同处在于,其关注点不是图像的区域或者通道,而是选择合适的操作。论文的整体结构图如下所示:

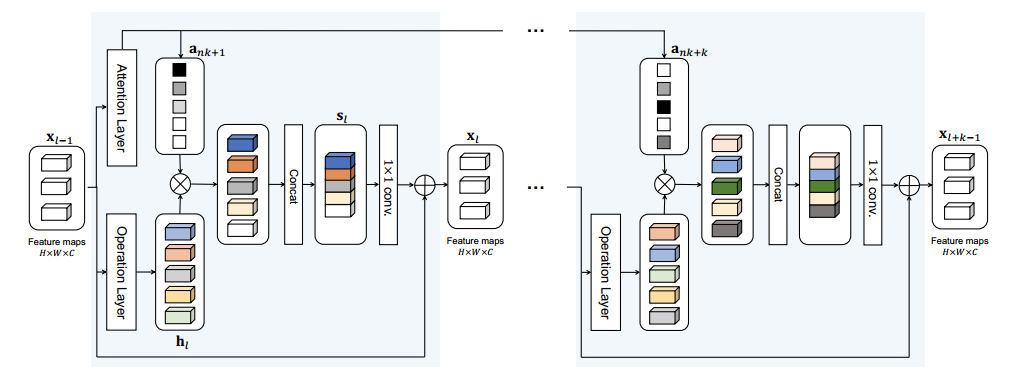

可以看出来论文的核心操作是那个attention模块,论文认为在一组层前面统一生成一系列attention map比每个层前面都生成attention map要稳定。所以这里将每K个层作为一组,首先计算这组输入在的均值,变成一个通道维的一维向量,如下所示:

然后计算权重时,通过以下两个式子:

注意这里对于每一层它们的attention权重生成部分的输入z都是一样的,不同的是每层使用不同的W2和W1计算权重,然后对权重进行归一化。最后将权重和操作部分相乘,然后将这些层的结果concat在一起,通过1x1卷积进行变换,和输入进行相加。整体结构如下图所示:

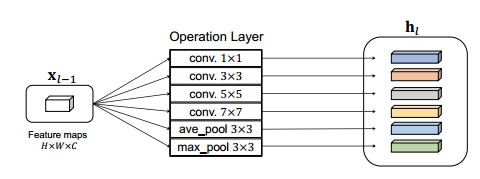

然后就是操作层,由各种参数的卷积核并行而成,一个例子如下所示:

此外还包括特征提取层,由一系列的残差模块组成,和输出层,是一个3x3的卷积。论文训练的Loss使用L1 loss。其他部分见论文。